揭秘神奇视频生成工具Sora,1分钟一镜到底是怎么回事?

发布时间:2024-05-22 14:00:07 浏览量:132次

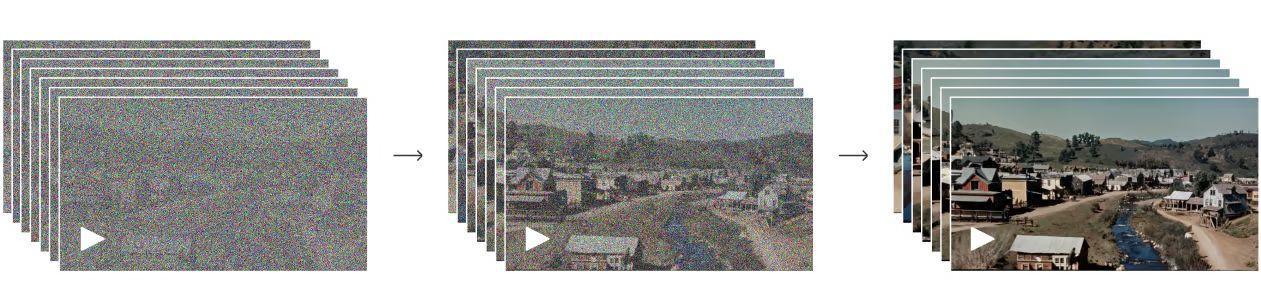

最近,OpenAI 推出了全新的AI视频生成工具Sora,一经亮相就引发了热烈关注。

就连马斯克也对Sora的强大功能赞不绝口,预言未来几年人类将借助AI创作出更加出色的作品。

Sora的强大之处在于能根据文本描述,生成长达1分钟的连贯流畅视频,展现出细腻的场景、生动的角色表现和复杂的镜头运动。

与其他只能生成短视频的工具相比,Sora的一分钟视频时长可谓独树一帜。

不仅如此,Sora在视频真实性、长度、稳定性、分辨率和对文本理解方面都达到了目前的最佳水准。让我们先欣赏一段官方演示视频片段。

提示:美丽而雪白的东京城市熙熙攘攘。摄像头穿越熙熙攘攘的城市街道,跟随着几个人在美丽的雪天享受购物。绚丽的樱花花瓣随着风和雪花一起飘扬。

在这段视频中,无人机镜头下,一对情侣在繁华的城市街道穿行,美丽的樱花花瓣随着雪花飘落。

当其他工具还在苦苦维持单一镜头稳定时,Sora已经游刃有余地实现多镜头的无缝切换,且切换连贯性和对象一致性效果遥遥领先。

▲源自 @gabor

过去,制作这样的视频可能需要耗费大量时间和精力进行剧本创作和分镜头设计等繁琐工作。而如今,只需简单的文本描述,Sora就能轻松生成这种华丽场面,相关从业者可能已感到压力山大。

网友@debarghya_das使用OpenAI Sora剪辑、David Attenborough的声音和Youtube上的音乐样本,仅用15分钟就制作了这个20秒的预告片。

Sora是如何实现强大效果的?

OpenAI发布了一份关于Sora详细的技术报告,详细介绍了其背后的技术原理和应用。

那么,Sora是如何实现这一突破的呢?受LLM成功实践经验的启发,OpenAI引入了视觉块嵌入代码(patches),这是一种高度可扩展且有效的视觉数据表现形式,能够显著提升生成模型处理多样化视频和图像数据的能力。

Sora在压缩后的潜在空间中进行训练,能以不同分辨率、持续时间及宽高比生成视频内容。这种处理方式使得预测和处理视频更加高效和精确。

探索AI的下一个方向 - 世界模型

OpenAI发现,在大规模训练下,Sora展现出了一系列引人注目的能力,能够在一定程度上模拟真实世界中的人、动物和环境。

这种能力是由大规模数据驱动产生的,能生成连贯的三维空间、保持物体连续性以及模拟数字世界。

- 三维空间的连贯性

Sora能生成带有动态视角变化的视频,人物和元素在不同角度下保持连贯性。 - 远距离连续性与物体持久性

Sora能保持视频的连续性,即使物体被遮挡或离开画面。 - 数字世界的模拟

Sora能模拟数字化过程,如视频游戏。

OpenAI视Sora为能够理解和模拟现实世界的模型的基础,相信其能力将是实现AGI的重要里程碑。

热门资讯

-

1. 华为手机神奇“AI修图”功能,一键消除衣服!原图变身大V领深V!

最近华为手机Pura70推出的“AI修图”功能引发热议,通过简单操作可以让照片中的人物换装。想了解更多这款神奇功能的使用方法吗?点击查看!

-

近年来,人工智能逐渐走入公众视野,其中的AI图像生成技术尤为引人注目。只需在特定软件中输入关键词描述语以及上传参考图就能智能高效生成符合要求的...

-

想将照片变成漫画效果?这篇文章分享了4个方法,包括Photoshop、聪明灵犀、VanceAI Toongineer、醒图,简单操作就能实现,快来尝试一下吧!

-

4. 一款免费无限制的AI视频生成工具火了!国内无障碍访问!附教程

人人都可以动手制作AI视频! 打开网址https://pixverse.ai/,用邮箱注册后,点击右上角Create,就可以开始创作了。 PixVerse目前有文案生成视频,和图片生...

-

以下是一些免费的AI视频制作网站或工具,帮助您制作各种类型的视频。 1. Lumen5:Lumen5是一个基于AI的视频制作工具,可将文本转换为视频。 用户可以使...

-

6. 零基础10分钟生成漫画,教大家如何用AI生成自己的漫画

接下来,我将亲自引导你,使用AI工具,创作一本既有趣又能带来盈利的漫画。我们将一起探索如何利用这个工具,发挥你的创意,制作出令人惊叹的漫画作品。让...

-

就能快速生成一幅极具艺术效果的作品,让现实中不懂绘画的人也能参与其中创作!真的超赞哒~趣趣分享几款超厉害的AI绘画软件,提供详细操作!有需要的快来...

-

8. AI视频制作神器Viggle:让静态人物动起来,创意无限!

Viggle AI是一款免费制作视频的AI工具,能让静态人物图片动起来,快来了解Viggle AI的功能和优势吧!

-

9. 10个建筑AI工具,从设计到施工全覆盖!肯定有你从来没听过的

讲述了建筑业比较著名的AI公司小库科技做出的探索,在这儿就不多说了。今天,我们试着在规划设计、建筑方案设计、住宅设计、管道设计、出渲染图、3D扫...

-

10. Logo Diffusion——基于sd绘画模型的AI LOGO 生成器

这下LOGO设计彻底不用求人了。接下来详细演示一遍操作流程首先进入Logo D... 想学习更多AI技能,比如说关于怎么样利用AI来提高生产效率、还能做什么AI...

最新文章

火星网校

火星网校