从零开始玩转Stable Diffusion,本地绘图轻松搞定

发布时间:2024-08-11 14:43:29 浏览量:173次

#头条创作挑战赛#

写在前面

OpenAI 这段时间发布了许多工具,如GPT系列语言模型、DALL-E图像生成模型和Codex编程辅助模型等,这些工具在文本生成、图像创作和代码编写领域得到了广泛应用。最近推出的Sora更是实现了文本到视频直接生成,对于创作者来说简直是神器。

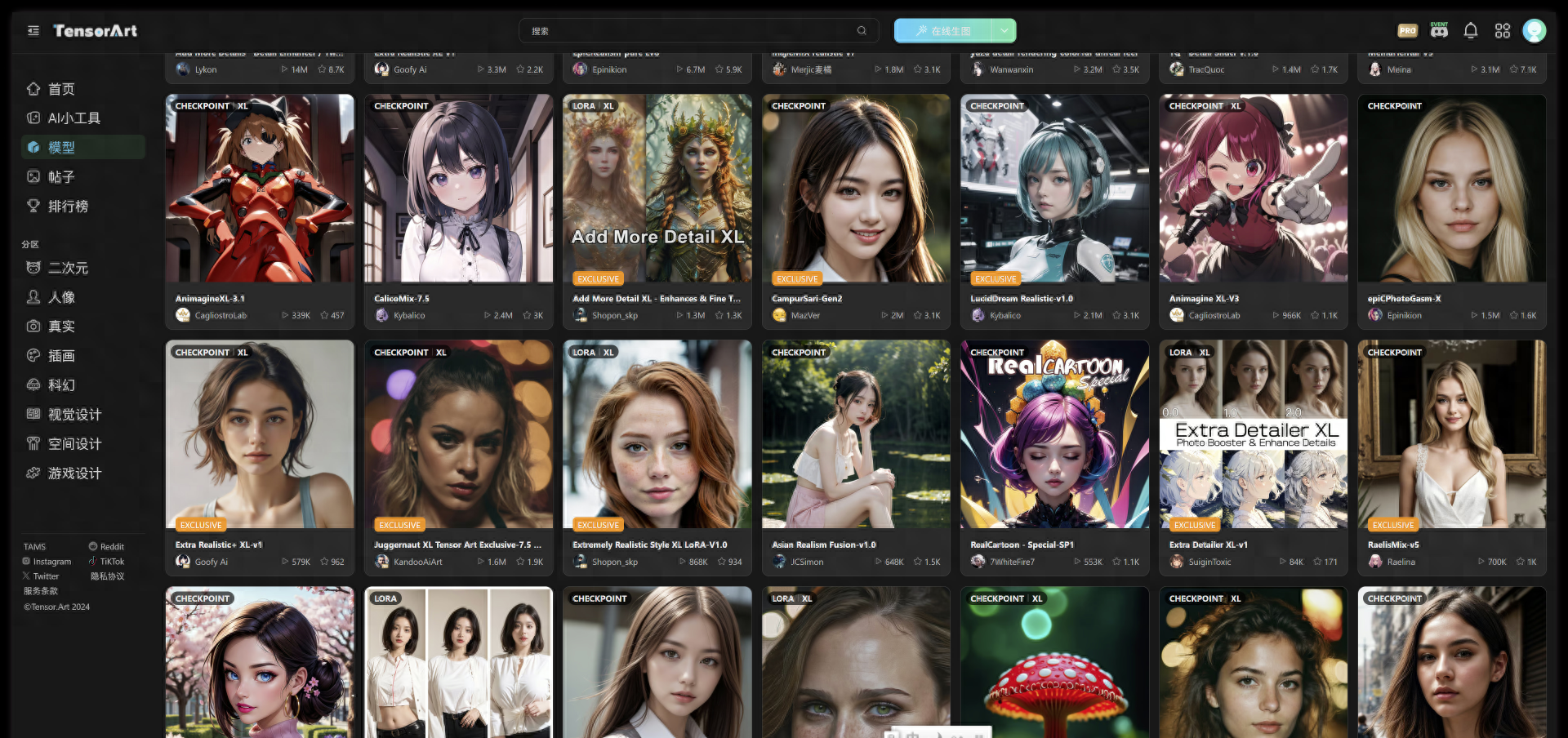

我最近在尝试使用Stable Diffusion,这个开源工具提供了多种模型,绘制出的图像质量也非常高,还能避免版权纠纷,是一个很好的创作工具。顺便推荐一下tensor网站,支持多种模型,可以实现文字绘图,而且免费额度非常高。

网站支持中文显示,中文关键词还能自动转换为英文。以下是我绘制的机甲美女图片。

尽管在线绘图工具Midjourney使用方便,但本地部署另有奥妙。这次我来和大家分享如何利用显卡进行本地绘图的方案Stable Diffusion。

本地部署绘图工具 Stable Diffusion

以前搭建Stable Diffusion需要折腾Python环境,但自从出现整合包以后,搭建过程就变得相当简单舒适了,更新也变得自动化。

目前流行的整合包是秋叶aaaki和独立研究员星空,两者使用的内核一样,区别在于界面和集成的插件不同。我在这里使用秋叶aaaki整合包作为演示。

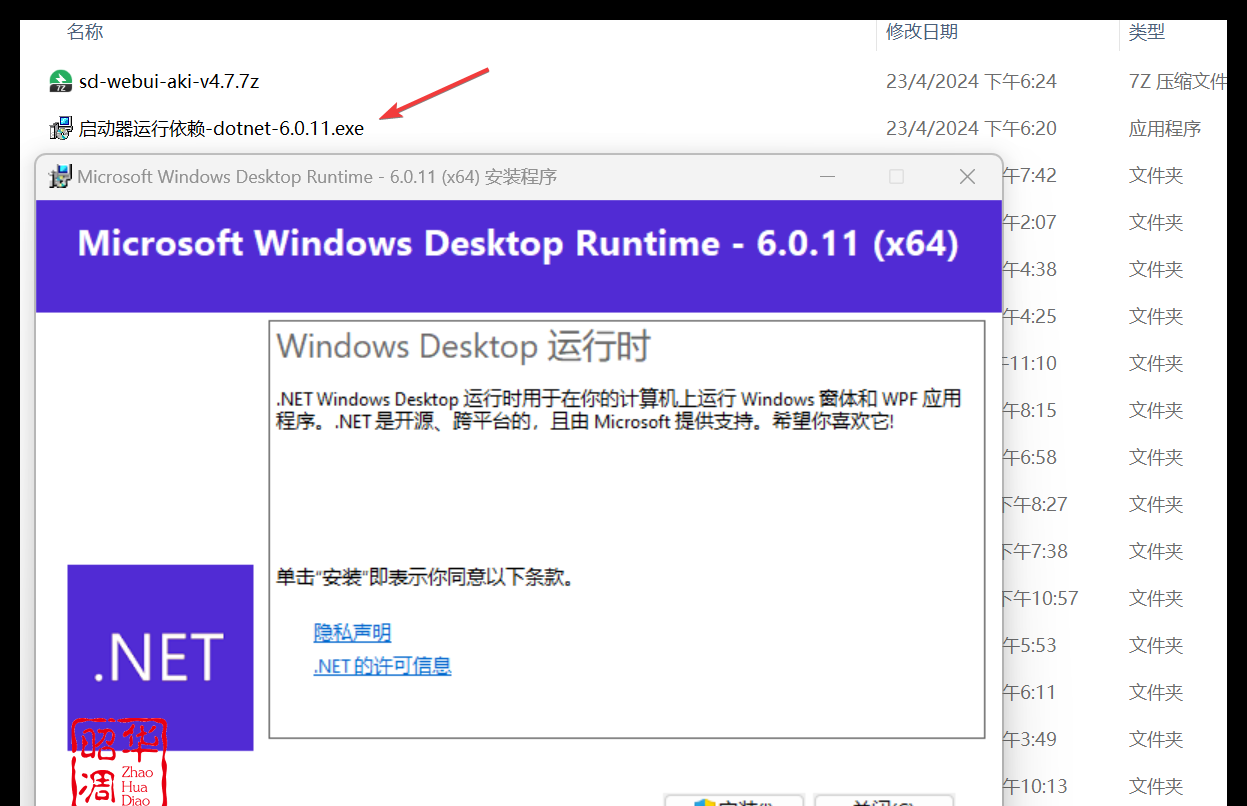

初次运行时需要安装依赖包。

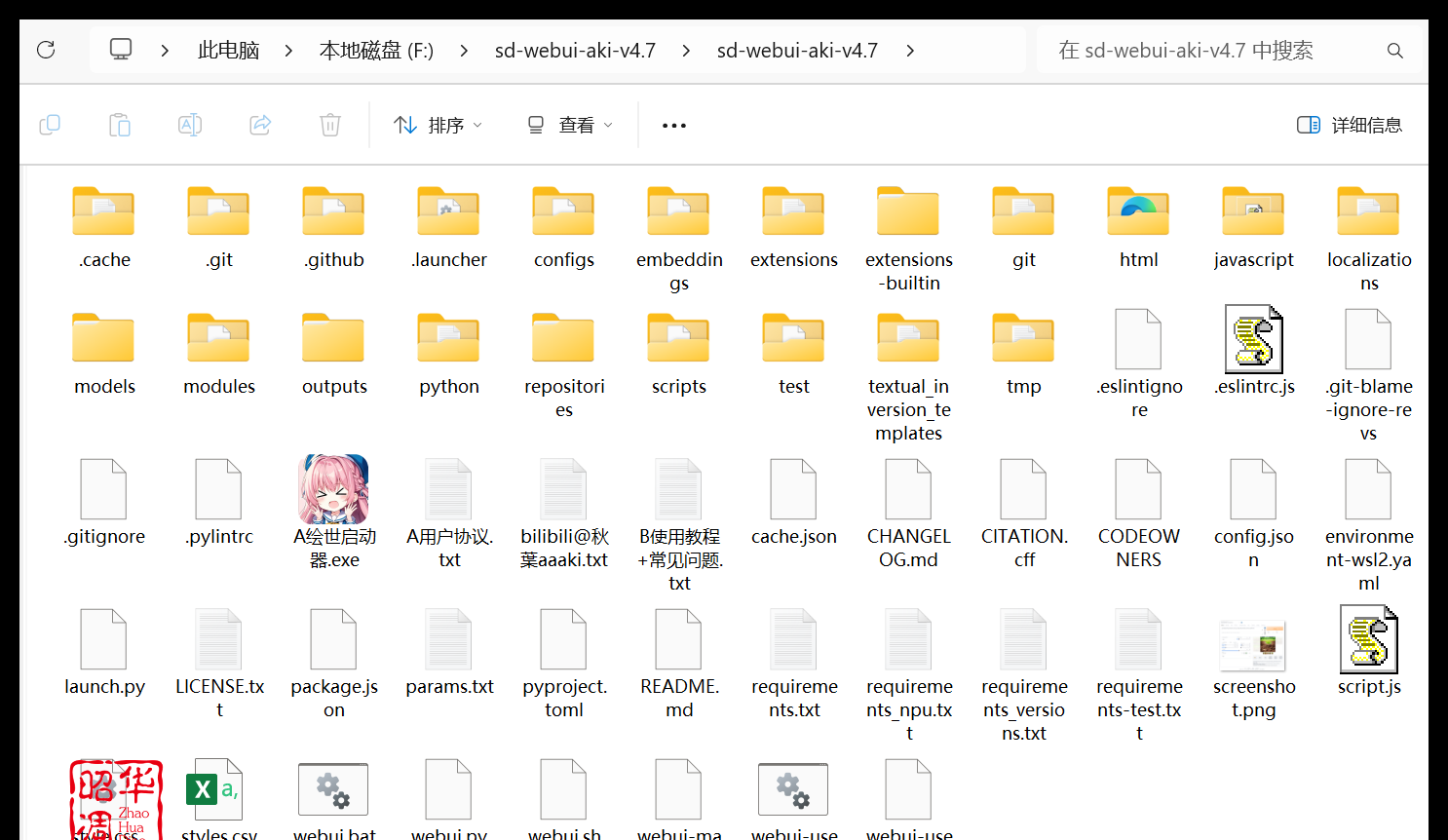

解压下载好的整合包后,运行"A绘世启动器.exe"。

注意:解压文件不要放在中文目录。

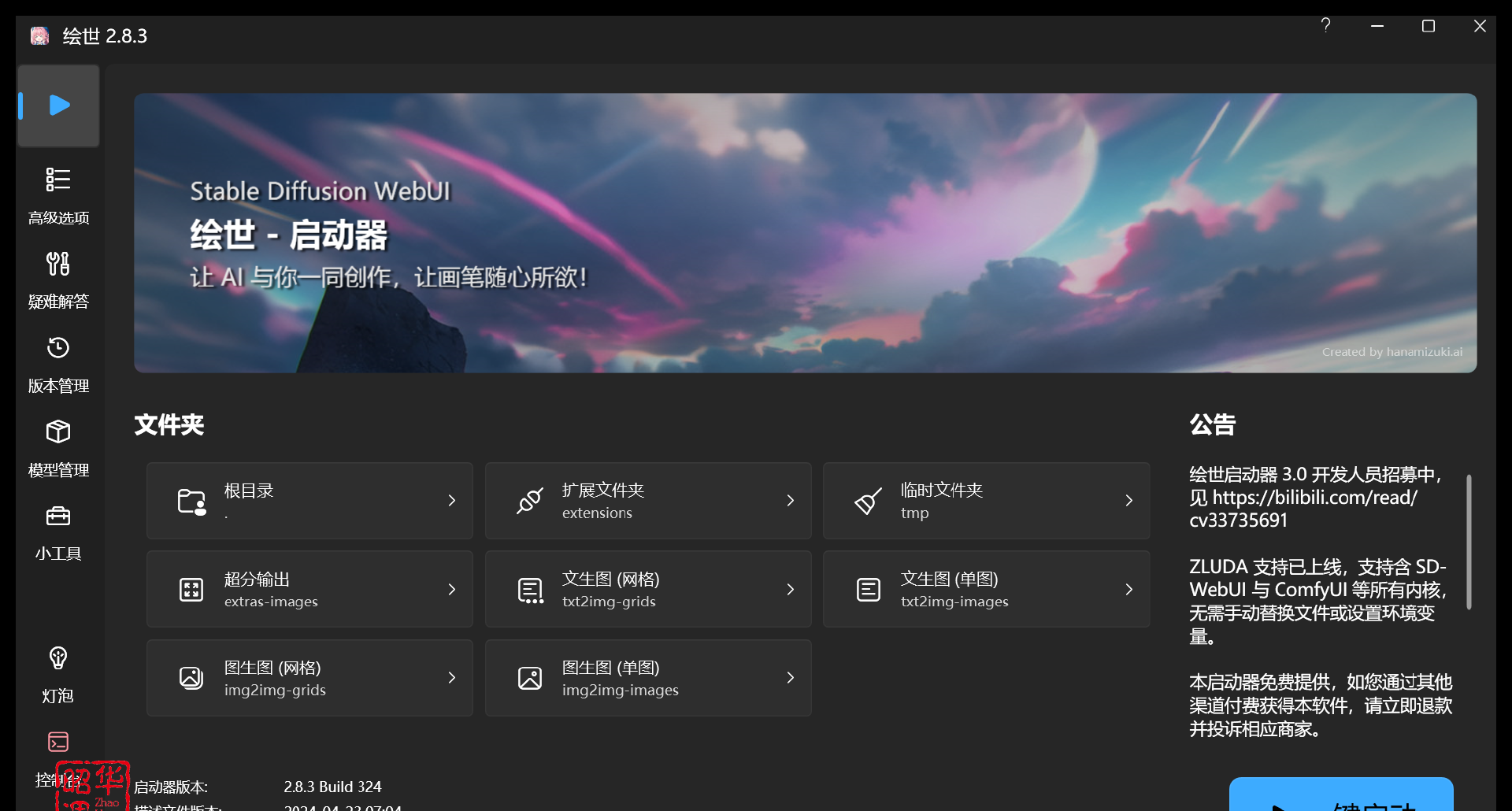

启动界面点击“一键启动”,程序会自动加载必须的启动项。

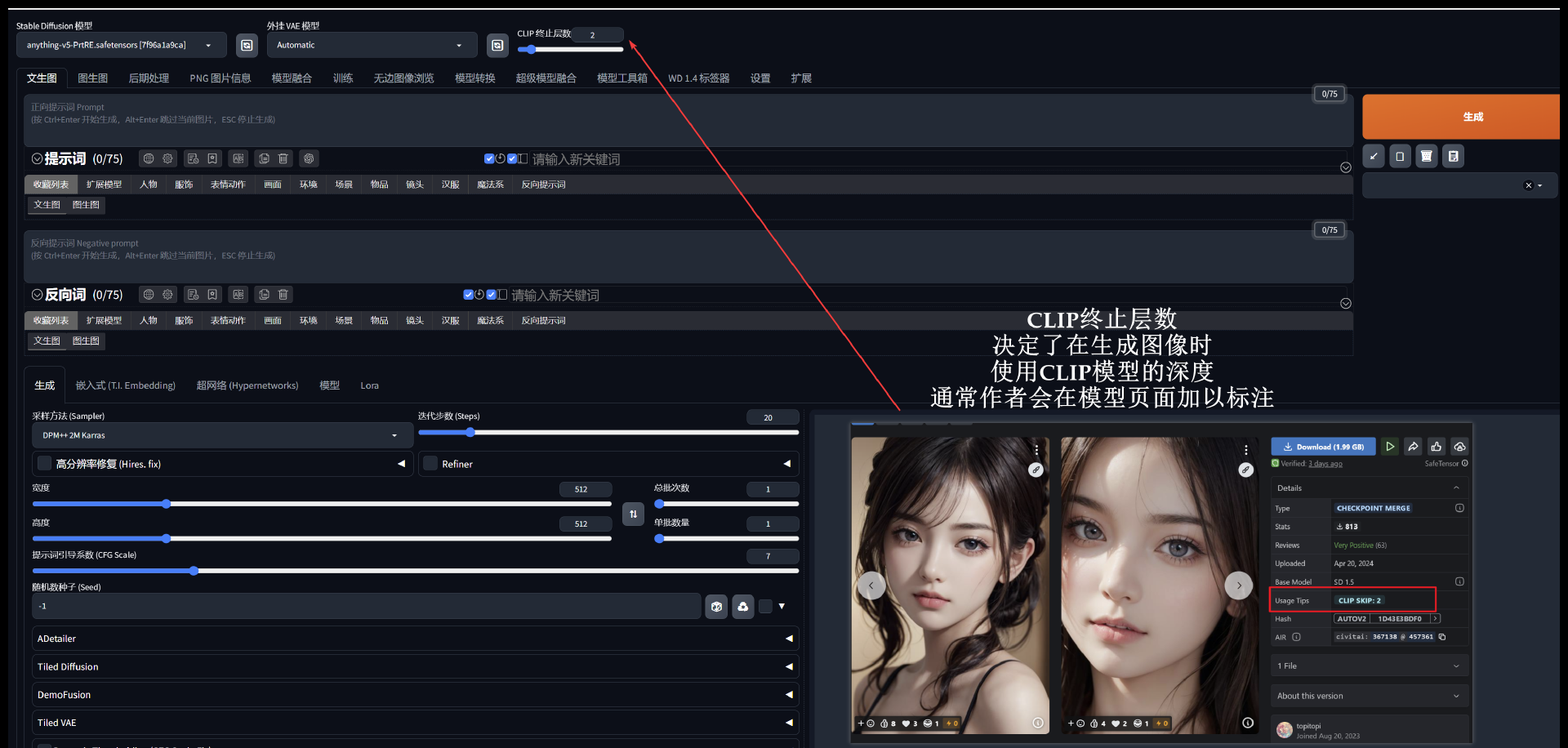

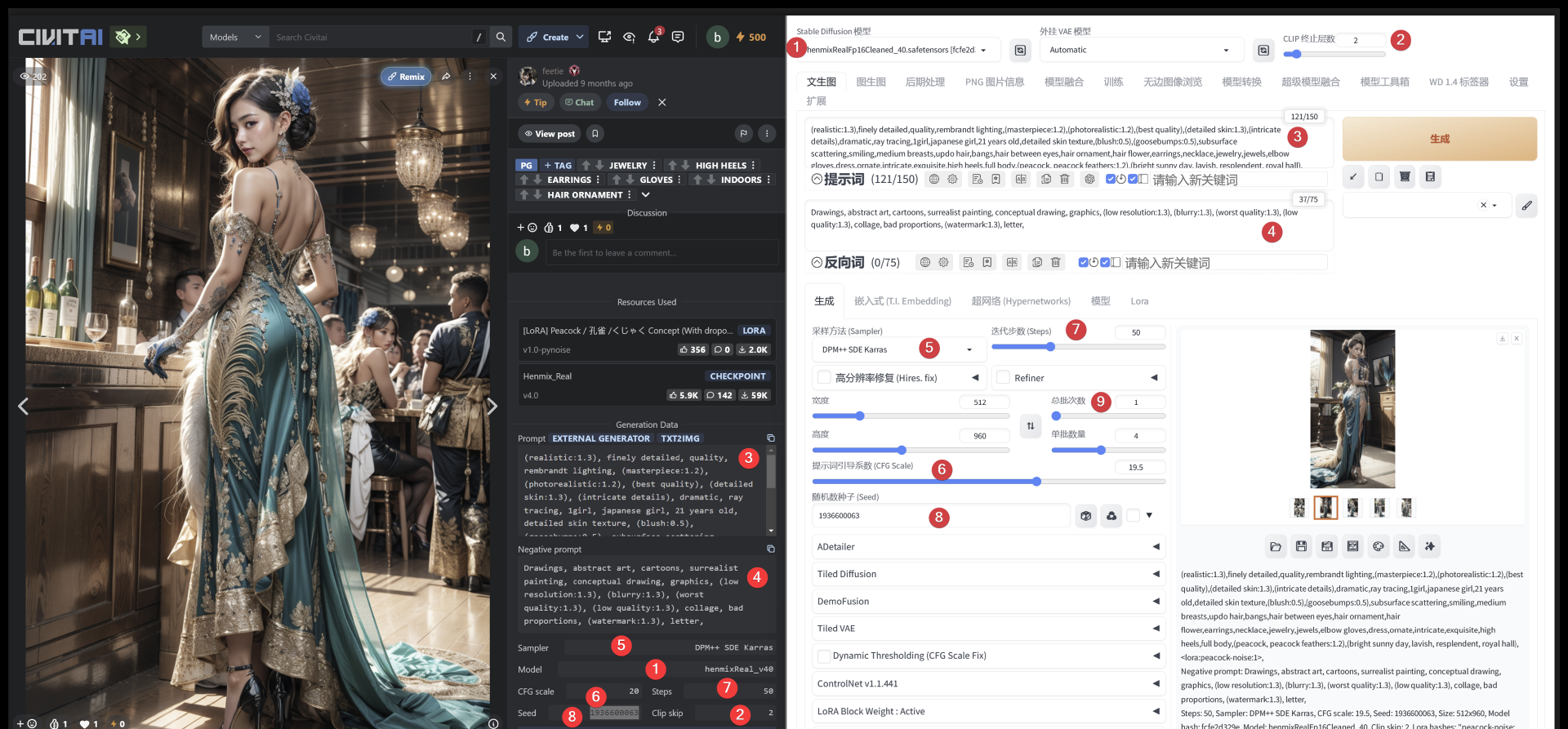

启动成功后的界面如图所示,强烈建议下载最新版本,常用插件已经设置好,包括汉化包、无边图像浏览等,甚至CLIP终止层数也自动显示在右上角,无需手动安装。

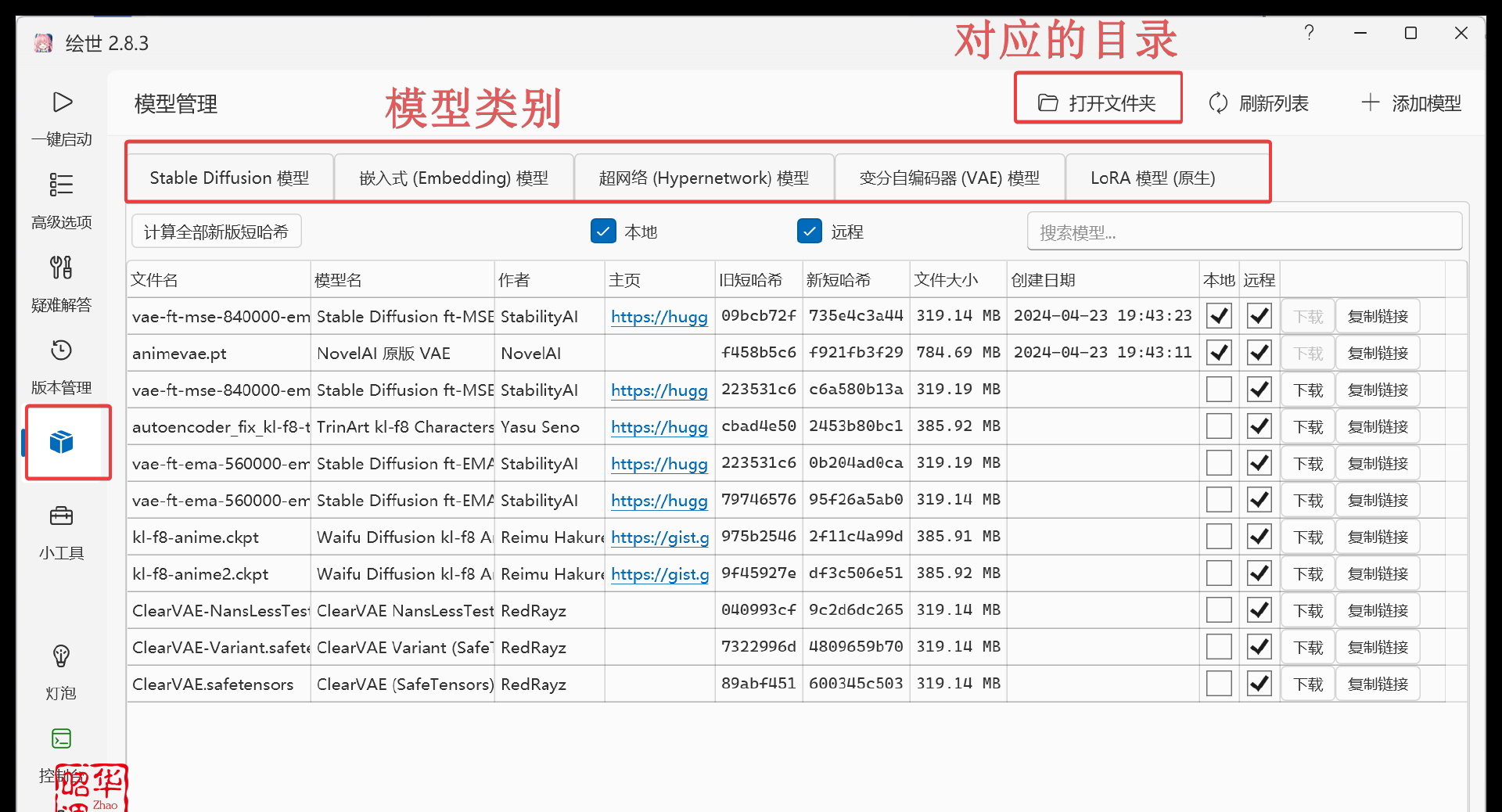

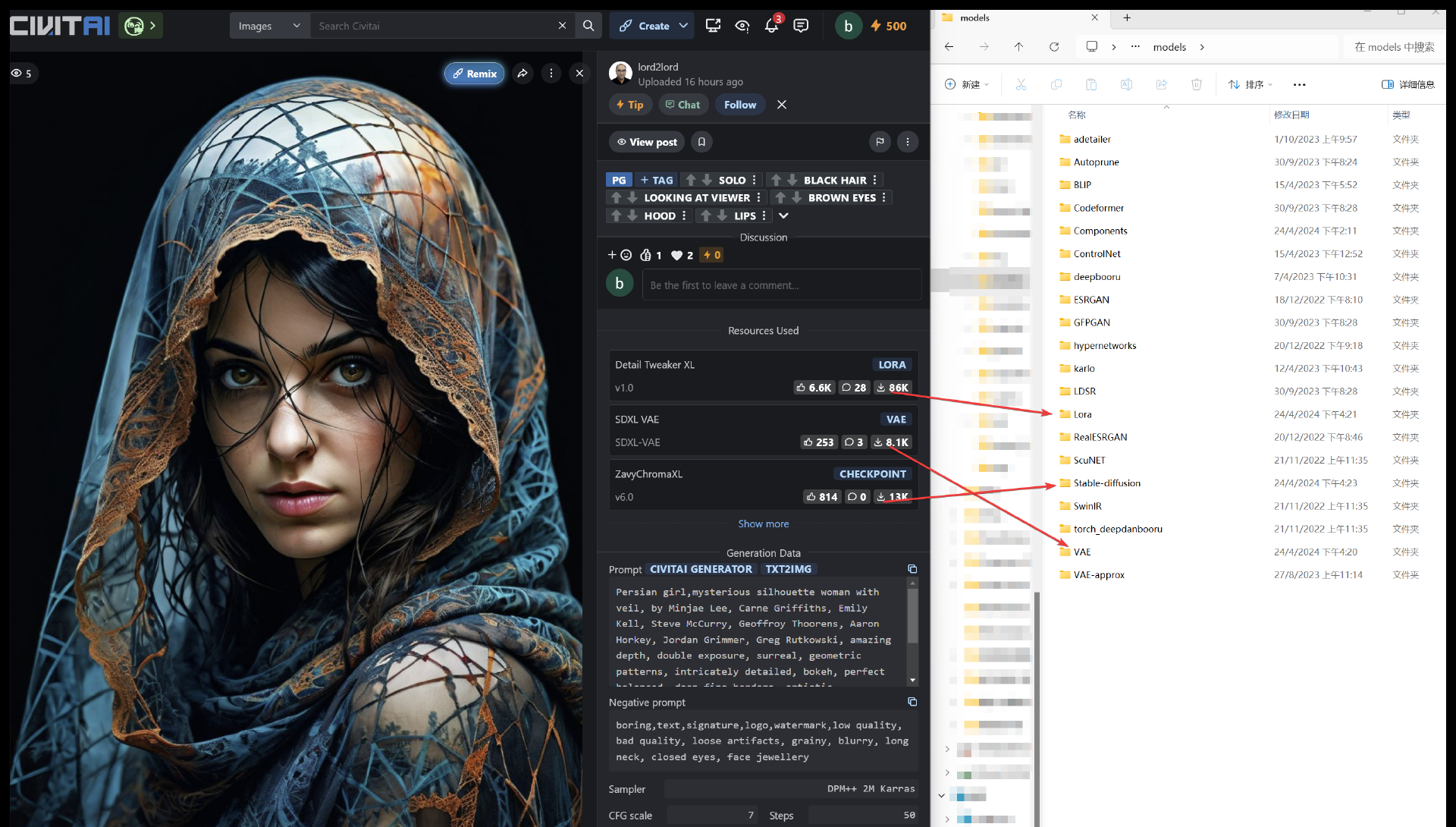

点击模型类别再点击上方按钮,可以快速定位模型保存目录,非常实用。

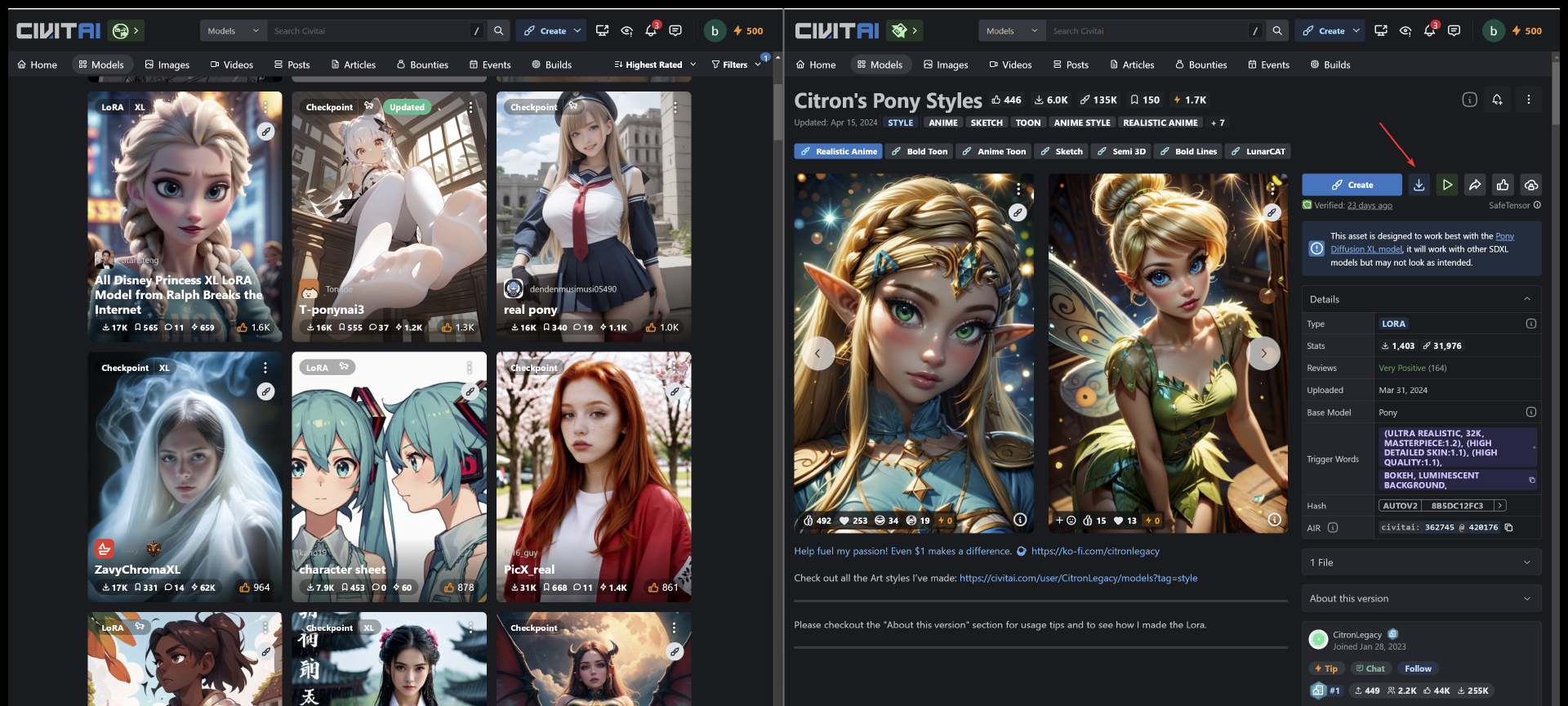

更建议从专业站点下载模型,比如civitai和liblibAI,模型数量多且能预览风格,点击下载按钮即可。

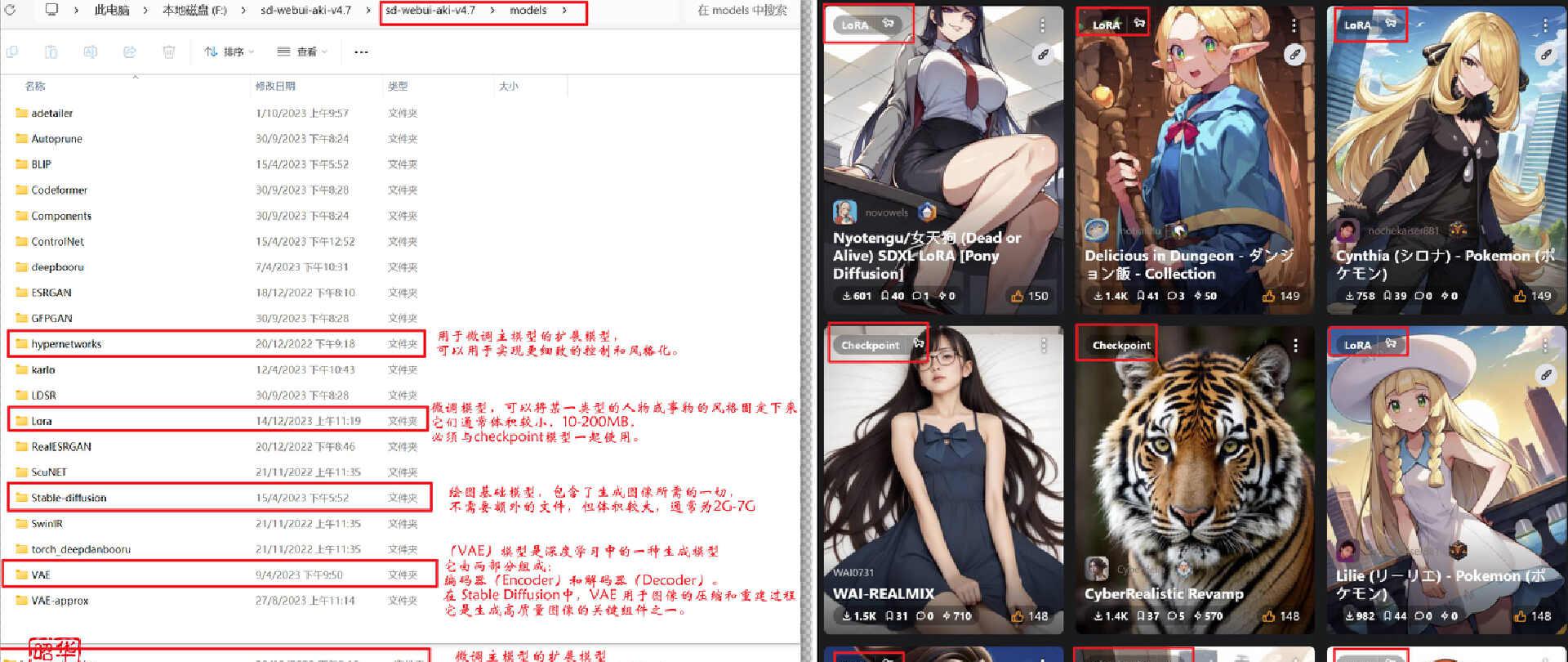

Stable Diffusion的模型种类虽然多,但类别并不多,下载模型时可以看到模型对应的类别,下载后也要放入相应目录。

Stable Diffusion使用的界面不同模型、提示词、设置出来的图像都各不相同,这也是AI绘图最有趣的地方。初次使用建议参考网上的成品图微调参数,以便更好地理解各个参数的作用。

以下是对照成品图的设置:

输出的图像质量不错,不过脸部有点崩,因为没有使用专门的脸部模型。

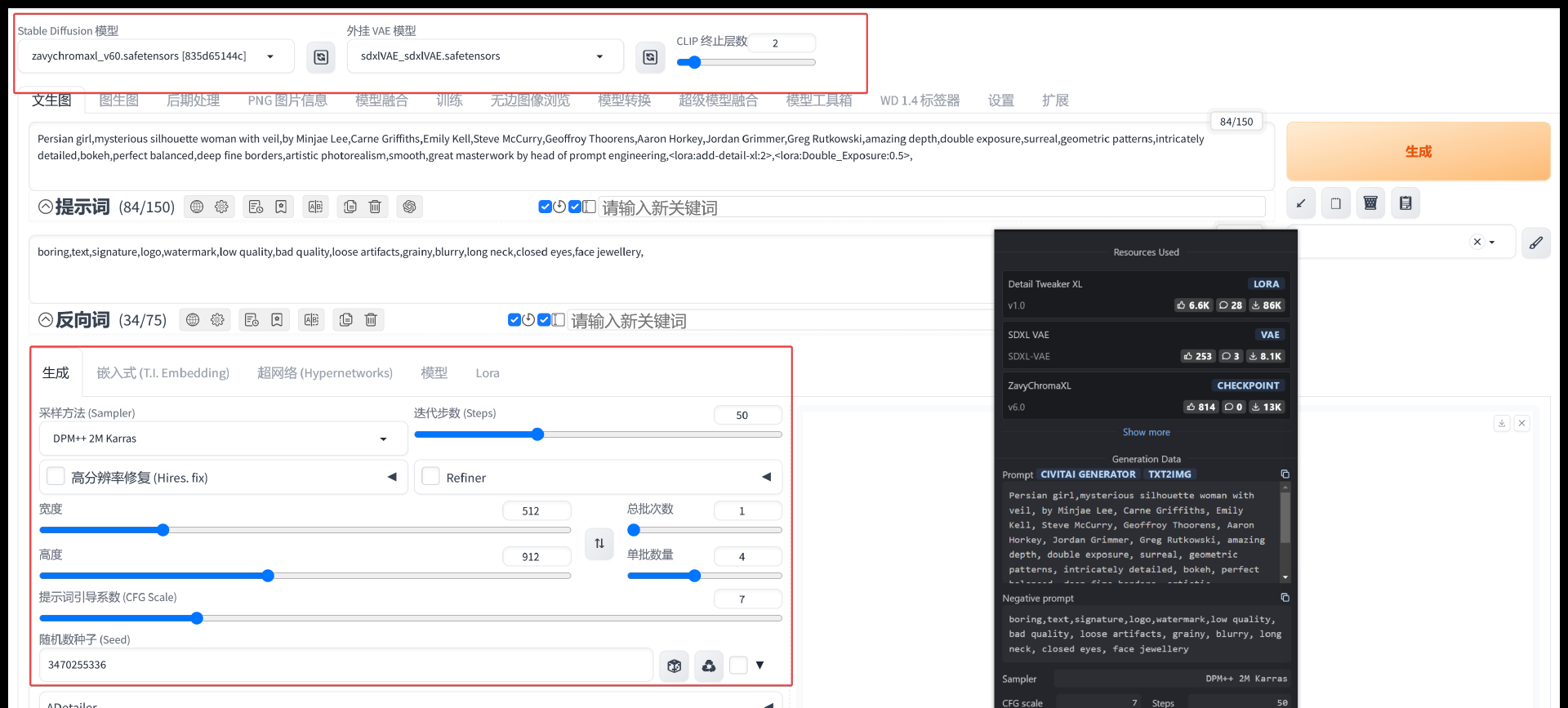

接下来实战一张图,观察到使用了三个模型,下载并复制到相应目录。

设定参数,选择一次生成4张图。

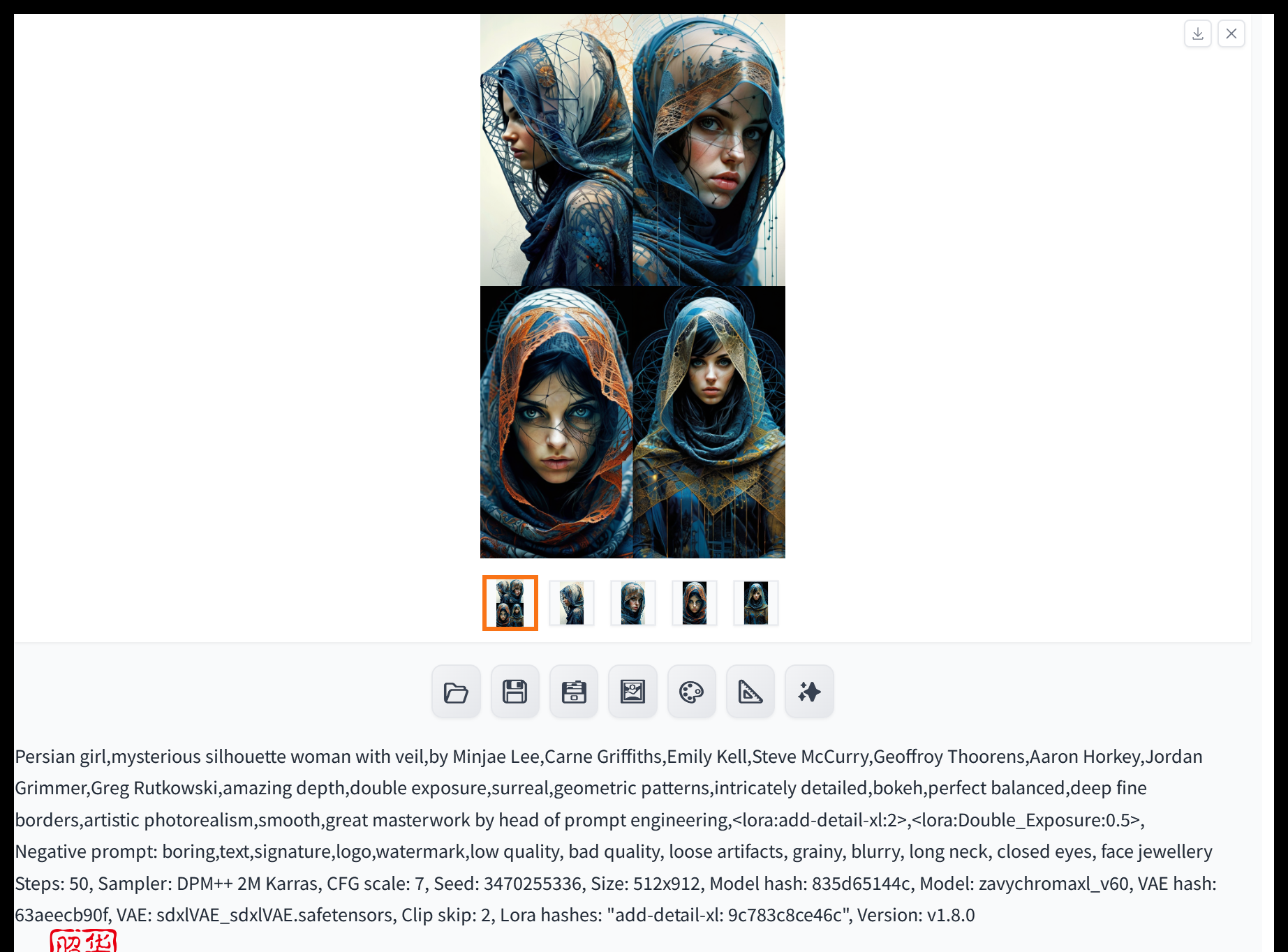

生成结束后,耗时41秒,显存占用接近12G,现在可以体会到大显存的好处了吧。下一篇我准备做一个不同显卡跑Stable Diffusion的对比测试。

只要模型和种子数与原图相同,生成的成品可以完美复刻原图。

最后

一篇简单的Stable Diffusion搭建教程,但玩转SD最重要的是模型。下次我考虑做显卡性能对比,或者专门推荐模型,感兴趣的朋友可以关注一波。

想要学习更多关于数字艺术的内容吗?欢迎了解关于数字艺术的课程,专业老师教学,让您快速掌握技能。

热门资讯

-

1. 华为手机神奇“AI修图”功能,一键消除衣服!原图变身大V领深V!

最近华为手机Pura70推出的“AI修图”功能引发热议,通过简单操作可以让照片中的人物换装。想了解更多这款神奇功能的使用方法吗?点击查看!

-

近年来,人工智能逐渐走入公众视野,其中的AI图像生成技术尤为引人注目。只需在特定软件中输入关键词描述语以及上传参考图就能智能高效生成符合要求的...

-

想将照片变成漫画效果?这篇文章分享了4个方法,包括Photoshop、聪明灵犀、VanceAI Toongineer、醒图,简单操作就能实现,快来尝试一下吧!

-

4. 一款免费无限制的AI视频生成工具火了!国内无障碍访问!附教程

人人都可以动手制作AI视频! 打开网址https://pixverse.ai/,用邮箱注册后,点击右上角Create,就可以开始创作了。 PixVerse目前有文案生成视频,和图片生...

-

以下是一些免费的AI视频制作网站或工具,帮助您制作各种类型的视频。 1. Lumen5:Lumen5是一个基于AI的视频制作工具,可将文本转换为视频。 用户可以使...

-

6. 零基础10分钟生成漫画,教大家如何用AI生成自己的漫画

接下来,我将亲自引导你,使用AI工具,创作一本既有趣又能带来盈利的漫画。我们将一起探索如何利用这个工具,发挥你的创意,制作出令人惊叹的漫画作品。让...

-

就能快速生成一幅极具艺术效果的作品,让现实中不懂绘画的人也能参与其中创作!真的超赞哒~趣趣分享几款超厉害的AI绘画软件,提供详细操作!有需要的快来...

-

8. AI视频制作神器Viggle:让静态人物动起来,创意无限!

Viggle AI是一款免费制作视频的AI工具,能让静态人物图片动起来,快来了解Viggle AI的功能和优势吧!

-

9. 10个建筑AI工具,从设计到施工全覆盖!肯定有你从来没听过的

讲述了建筑业比较著名的AI公司小库科技做出的探索,在这儿就不多说了。今天,我们试着在规划设计、建筑方案设计、住宅设计、管道设计、出渲染图、3D扫...

-

10. Logo Diffusion——基于sd绘画模型的AI LOGO 生成器

这下LOGO设计彻底不用求人了。接下来详细演示一遍操作流程首先进入Logo D... 想学习更多AI技能,比如说关于怎么样利用AI来提高生产效率、还能做什么AI...

最新文章

火星网校

火星网校