你的AI视频工具,可能马上就要过时了

作者:脑洞君

发布时间: 2026-04-13 13:28:46

浏览量:0次

作者:脑洞君

发布时间: 2026-04-13 13:28:46

浏览量:0次

4月8日,AI 视频圈出了一件说大不大、说小也不小的事。

一款叫 HappyHorse-1.0 的模型,在没有任何发布会、没有技术博客、甚至没有公司官方背书的情况下,空降 Artificial Analysis 的 AI Video Arena 排行榜,直接拿下了榜首。

HappyHorse-1.0 是什么

先说清楚它是什么。

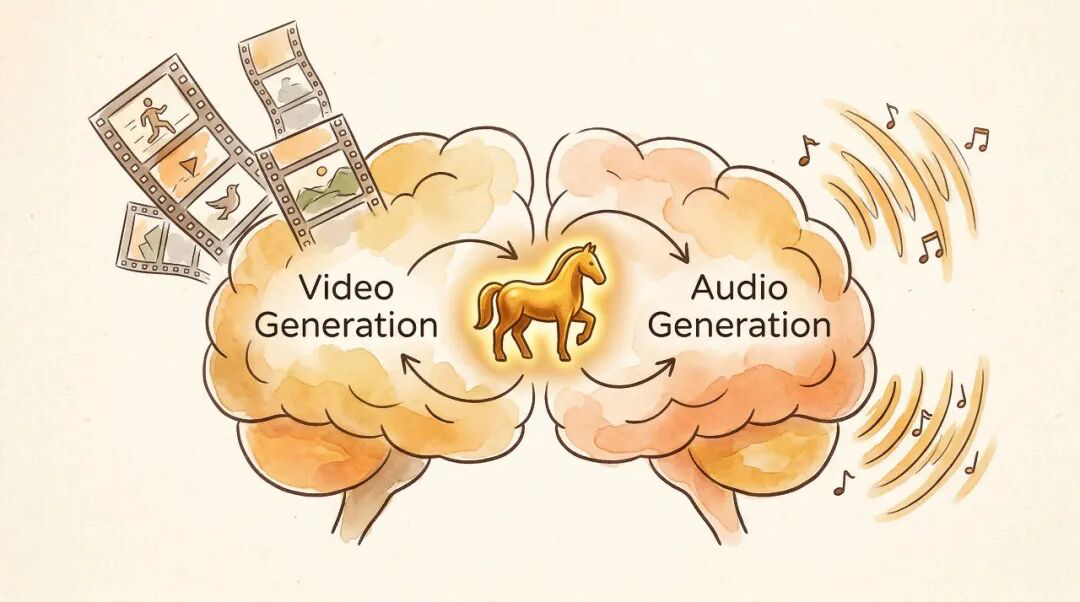

HappyHorse-1.0 是一款开源 AI 视频生成模型,150 亿参数,支持文生视频和图生视频两种模式。最高输出 1080p 高清视频,而且能同步生成音频——这一点目前大多数模型还做不到。

它的核心成绩是这样的:

-

文生视频盲测榜:Elo 1347,第一名 -

图像转视频盲测榜:第一 -

视音频联合建模:第一 -

Artificial Analysis 官方评价:电影级画质,物理真实感极强,提示词遵循度高

开源,MIT 协议,可以商用。

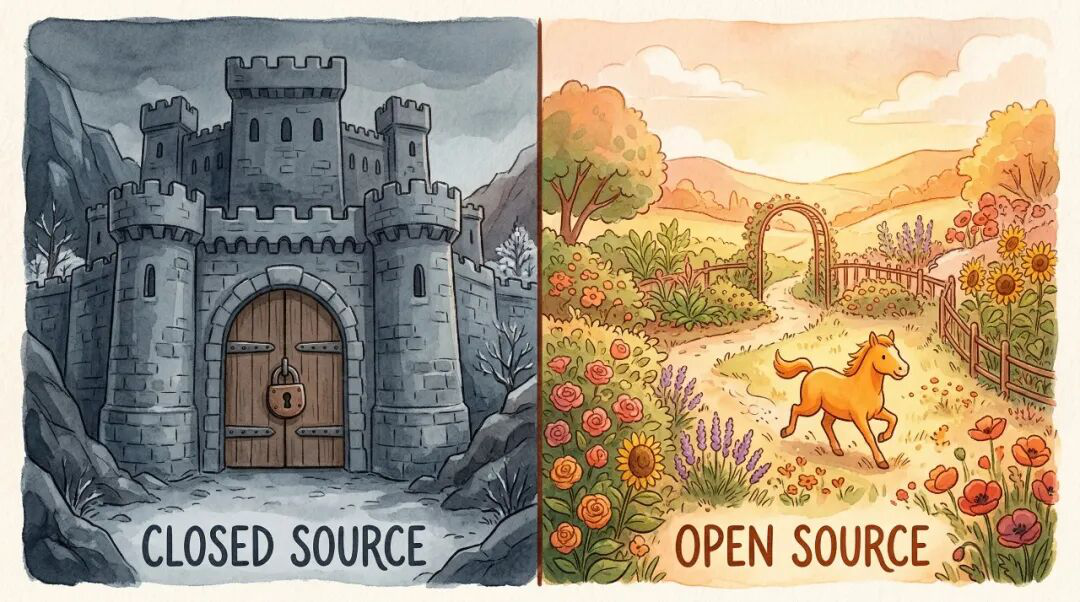

技术参数就不念了。我想说的是一件事:这是一款开源模型,在权威盲测里,把目前所有闭源头部都压了一头。

这件事本身,比 HappyHorse 这个名字要重要得多。

"匿名发布"背后是什么逻辑

让我稍微展开一下"匿名发布"这件事。

在 HappyHorse 之前,过去一年里 LMArena、Image Arena、Code Arena 陆续出现过好几次类似的模式——先匿名打榜,再公开认领。

具体做法是:不做任何宣传,直接把模型扔到权威评测平台上,让分数说话。等排名稳了、话题热度起来了,再由匿名团队出来"哦其实是我们做的"。效果往往比开一场发布会还要好。

但 HappyHorse 更极端。

它不止是匿名——到现在也没有人认领。

有人在知乎上分析,有人在 v2ex 上问,有人去查域名注册信息,查出来的线索指向中国团队,但没有任何官方确认。"HappyHorse"这个名字本身也是一个彩蛋:2026 年是农历马年,年初就有"Pony.ai"这样的命名(小程序马),"Happy Horse"几乎是明牌的马年彩蛋。

但这只是推测。

我也不知道是谁做的。

它和现在的视频 AI 有什么不一样

如果你用过可灵、用过 Runway、用过 Pika,你大概知道目前的 AI 视频生成有几个通病:

一个是运动幅度小,镜头动一下就容易糊;一个是提示词遵循差,让它做"人物从左往右走",出来的东西可能完全不对;还有一个是音频和视频两张皮,声音和画面经常对不上。

HappyHorse 解决的是第三件事:视音频联合建模。

不是先生成视频再配音,是一起生成。这是它和大多数现有模型在架构层面的根本差异。

至于前两个问题——运动幅度和提示词遵循——从排行榜的评分来看,至少在盲测环境下,它的表现也明显优于 Seedance 2.0 和可灵。

但我要说一句:这个成绩是评测环境打出来的。真实使用场景和评测榜单之间,往往有一层窗户纸。具体体验怎么样,还需要等开源社区反馈。

开源这件事,到底意味着什么

很多人在讨论 HappyHorse 的时候,焦点放在了"谁做的"上面。但我觉得更重要的问题是:开源视频模型能打闭源了,这件事本身意味着什么?

在此之前,AI 视频生成的格局基本是这样的:

- 闭源第一梯队

:Runway、Pika、可灵、Seedance——这几家靠技术和数据积累,吃掉了大多数商用市场 - 开源追赶者

:偶有开源模型冒头,但质量和闭源差距明显,更多是极客玩具

HappyHorse 把这个差距抹平了。

不是接近,是抹平——在盲测环境下,150 亿参数的开源模型在多个维度拿到第一。

如果这件事被验证是真实的(等开源社区大规模测试),那么:

第一,对普通用户来说,视频生成的门槛会大幅下降。你不需要付订阅费,不需要 API 调用,自己部署就能用。

第二,对闭源厂商来说,订阅费压力会变大。用户有了免费的高质量替代品,愿意付费的理由就少了一个。

第三,对整个 AI 视频行业来说,"开源能打闭源"这个认知一旦确立,后续会有大量资本和人才涌入开源方向,迭代速度会快很多。

当然,这一切的前提是它真的像榜单显示的那么强。我也不能排除榜单有偏向性的可能。具体的,等社区测评。

普通人现在能做什么

如果你是一个 AI 视频的从业者或者爱好者,我觉得有几件事值得做:

第一,去 GitHub 上关注这个项目。

开源地址已经有不少人 clone 了,社群正在快速扩张。早期参与的人,往往能拿到最好的讨论位置和资源积累。

第二,把现有工作流里的视频生成环节评估一下。

如果现在你用的是可灵或者 Runway,可以先查一下 HappyHorse 开源版在你的场景下的实际效果。如果接近,切换成本不高。

第三,盯住"视音频联合建模"这个方向。

音频和视频一起生成,看起来是小事,但实际上是内容生产效率的巨大提升。现在大多数AI视频还停留在"画面对了但声音是后期"的阶段,这个方向如果成熟,内容创作的工作流会被完全重构。

写到最后,我突然想到一件事。

大概两年前,AI 绘画刚出来的时候,也是一波"什么垃圾,根本没法用"的吐槽。然后 Stable Diffusion 出现了,开源社区跟进,一夜之间整个生态变了。

AI 视频现在大概就在这个节点上。

HappyHorse 是不是那个节点?我不确定。但它出现的姿势——匿名、空降、榜首——让这件事本身成了一个值得记住的注脚。

你的 AI 视频工具,可能马上就要过时了。

你们有没有看到 HappyHorse 的测评?什么感觉?评论区聊聊。

一 END 一

相关文章

最新发布

推荐教程

-

视频剪辑培训十大常见误区,资深剪辑师避坑指南

视频剪辑培训十大常见误区,资深剪辑师避坑指南 -

最新就业趋势下建模培训必备的7项专业技能

最新就业趋势下建模培训必备的7项专业技能 -

最新十大游戏开发培训机构实战课程对比评测

最新十大游戏开发培训机构实战课程对比评测 -

优质动漫绘画培训机构筛选标准全攻略

优质动漫绘画培训机构筛选标准全攻略 -

免费影视制作资源库:专业软件与插件合集推荐

免费影视制作资源库:专业软件与插件合集推荐 -

零基础影视剪辑教程:30天掌握核心剪辑思维

零基础影视剪辑教程:30天掌握核心剪辑思维 -

剪辑师培训全流程:从基础剪辑到高级特效指南

剪辑师培训全流程:从基础剪辑到高级特效指南 -

短视频与长视频剪辑师培训需求差异深度解析

短视频与长视频剪辑师培训需求差异深度解析 -

跨平台短视频培训:抖音B站小红书运营差异

跨平台短视频培训:抖音B站小红书运营差异 -

视频剪辑避坑指南:识别优质课程的七个维度

视频剪辑避坑指南:识别优质课程的七个维度 -

AI技术融合:3d建模培训班最新行业趋势解析

AI技术融合:3d建模培训班最新行业趋势解析 -

Maya与Blender动漫制作软件对比全攻略

Maya与Blender动漫制作软件对比全攻略 -

免费手绘学习资源库:线稿素材与笔刷合集推荐

免费手绘学习资源库:线稿素材与笔刷合集推荐 -

插画培训价格解析:不同课程性价比深度对比

插画培训价格解析:不同课程性价比深度对比 -

好莱坞认证课程:国际影视制作标准实战解析

好莱坞认证课程:国际影视制作标准实战解析 -

如何选择游戏开发引擎?Unity与Unreal对比测评

如何选择游戏开发引擎?Unity与Unreal对比测评

猜你喜欢

优秀作品赏析

作 者:李思庭

所学课程:2101期学员李思庭作品

作 者:林雪茹

所学课程:2104期学员林雪茹作品

作 者:赵凌

所学课程:2107期学员赵凌作品

作 者:赵燃

所学课程:2107期学员赵燃作品

火星网校

火星网校